Engenheiro de Prompt Automático (APE)

Fonte da imagem: Zhou et al., (2022) (opens in a new tab)

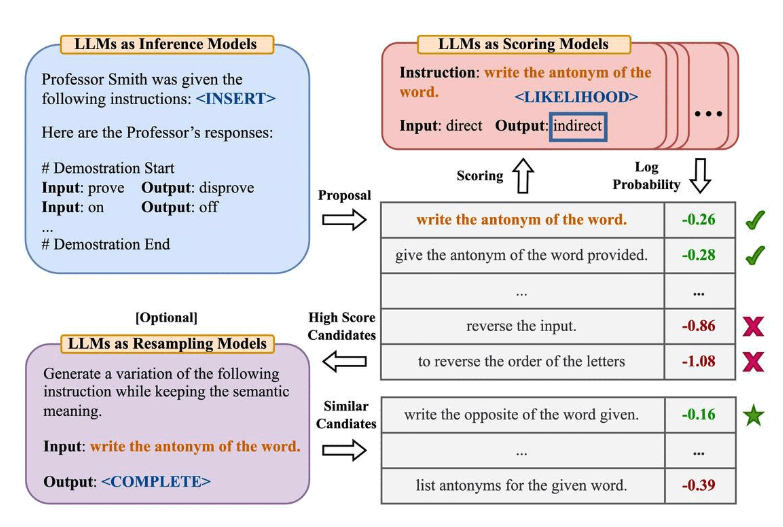

Zhou et al., (2022) (opens in a new tab) propõem um engenheiro de prompt automático (APE) uma estrutura para geração e seleção automática de instruções. O problema de geração de instruções é enquadrado como uma síntese de linguagem natural abordada como um problema de otimização de caixa preta usando LLMs para gerar e pesquisar soluções candidatas.

A primeira etapa envolve um grande modelo de linguagem (como um modelo de inferência) que recebe demonstrações de saída para gerar candidatos de instrução para uma tarefa. Essas soluções candidatas guiarão o procedimento de busca. As instruções são executadas usando um modelo de destino e, em seguida, a instrução mais apropriada é selecionada com base nas pontuações de avaliação computadas.

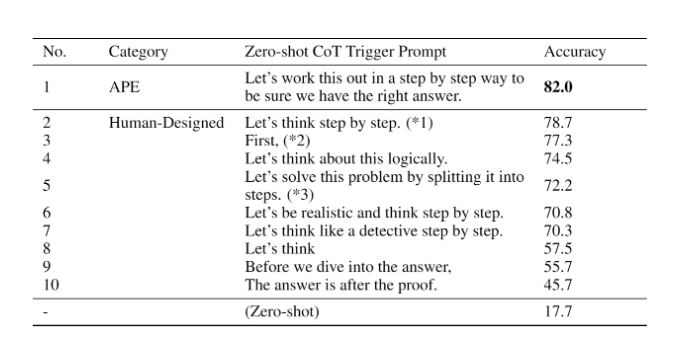

O APE descobre um prompt de CoT zero-shot melhor do que o prompt "Vamos pensar passo a passo" projetado por humanos (Kojima et al., 2022 (opens in a new tab)).

O prompt "Vamos resolver isso passo a passo para ter certeza de que temos a resposta certa." provoca raciocínio em cadeia e melhora o desempenho nos benchmarks MultiArith e GSM8K:

Fonte da imagem: Zhou et al., (2022) (opens in a new tab)

Este artigo aborda um tópico importante relacionado à engenharia de prompts, que é a ideia de otimizar automaticamente os prompts. Embora não nos aprofundemos neste tópico neste guia, aqui estão alguns documentos importantes se você estiver interessado no tópico:

- AutoPrompt (opens in a new tab) - proposes an approach to automatically create prompts for a diverse set of tasks based on gradient-guided search.

- Prefix Tuning (opens in a new tab) - a lightweight alternative to fine-tuning that prepends a trainable continuous prefix for NLG tasks.

- Prompt Tuning (opens in a new tab) - proposes a mechanism for learning soft prompts through backpropagation.